Künstliche Intelligenz sicher und rechtskonform einsetzen – So gelingt der Spagat

Kaum ein anderes Thema hat in den letzten Monaten für so viel Bewegung in Unternehmen gesorgt wie Künstliche Intelligenz (KI). Tools wie ChatGPT, Copilot oder andere generative KI-Modelle werden zunehmend in Arbeitsprozesse integriert – oftmals schneller, als es der IT oder der Rechtsabteilung lieb ist. Doch wie gelingt ein sicherer, datenschutzkonformer Einsatz dieser mächtigen Technologien?

KI ist da – und bleibt

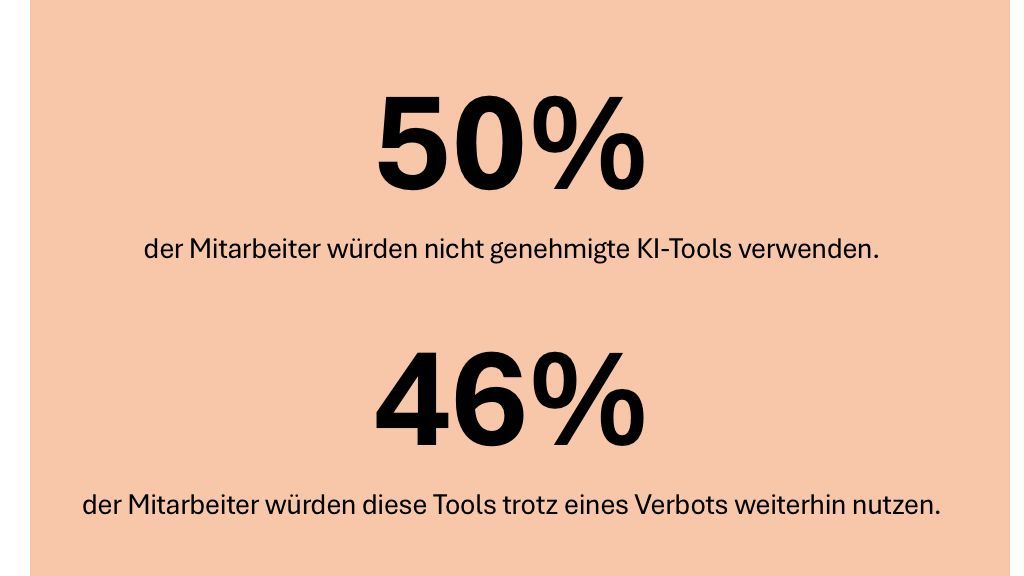

Ob im privaten Umfeld oder im Berufsleben: KI-Tools sind allgegenwärtig. Mitarbeitende nutzen sie bereits heute zur Textgenerierung, Datenanalyse oder für kreative Aufgaben. Das Problem: In vielen Fällen geschieht das ohne Wissen oder Freigabe der IT – sogenannte Schattennutzung. Dabei ist das Risiko hoch: personenbezogene Daten, Geschäfts-geheimnisse oder proprietäre Informationen könnten unkontrolliert in externe Systeme gelangen.

Rechtliche Grundlage: Der AI Act ist da

Mit dem AI Act (EU-Verordnung 2024/1689) schafft die EU erstmals einen einheitlichen Rechtsrahmen für den Einsatz von KI. Seit 2024 in Kraft, regelt er unter anderem:

- Kennzeichnungspflichten für KI-Systeme, die mit Menschen interagieren (seit Februar 2025)

- Strenge Anforderungen an sogenannte Hochrisiko-KI-Systeme (ab August 2025) Volle Wirksamkeit für alle betroffenen Unternehmen ab August 2026

Die Verordnung ist eng verzahnt mit der DSGVO und verlangt insbesondere Transparenz, Zweckbindung und Schutz personenbezogener Daten.

Die größten Herausforderungen

Die zentralen Risiken im Umgang mit generativer KI aus Unternehmenssicht:

- Datenschutzverletzungen: Mitarbeitende geben unbeabsichtigt sensible Informationen in KI-Systeme ein.

- Schatten-IT: Ohne technische und organisatorische Kontrolle entstehen Sicherheitslücken.

- Haftungsfragen: Unternehmen haften auch dann, wenn Mitarbeitende „privat“ KI-Tools im Arbeitsumfeld nutzen.

Der Mensch als Schwachstelle – aber auch als Lösung

Ein Drittel aller Sicherheitsvorfälle in Unternehmen ist auf menschliches Fehlverhalten zurückzuführen. Statt Verbote auszusprechen (wie einst beim Internetzugang in den 90ern), plädieren Experten für einen anderen Weg: Enablement statt Verbot. Technologische Schutzmaßnahmen – wie die Maskierung sensibler Daten direkt im Browser – ermöglichen Mitarbeitenden die sichere Nutzung von KI, ohne die Produktivität zu bremsen.

Best Practices für Unternehmen

- Transparenz schaffen: Wer nutzt KI – und wofür? Klare interne Regeln und Prozesse sind essenziell.

- Datenschutz technisch absichern: Tools wie Browser-Plugins oder Middleware-Lösungen können personenbezogene Daten automatisch erkennen und maskieren.

- Governance etablieren: Klare Leitlinien, Nutzungspolicies und Protokollierungen sind Pflicht.

- Aufklärung & Schulung: Mitarbeitende müssen wissen, was erlaubt ist – und was nicht.

- Technologische Souveränität wahren Wo immer möglich, sollte europäische oder selbst betriebene Infrastruktur bevorzugt werden.

Fazit: Zwischen Innovation und Verantwortung

Der Einsatz von KI in Unternehmen ist nicht nur ein Innovationsmotor, sondern auch ein rechtliches Minenfeld. Wer als Unternehmen die Chancen von KI nutzen möchte, muss Verantwortung übernehmen – technologisch, organisatorisch und ethisch. Mit der richtigen Strategie lässt sich das Spannungsfeld zwischen Effizienzgewinn und Datenschutz sicher meistern.